La red social Instagram comenzará a notificar a padres de familia si sus hijos adolescentes buscan de manera reiterada contenido relacionado con suicidio o autolesiones, informó su empresa matriz, Meta Platforms.

La compañía precisó que la medida entrará en vigor “la semana que viene” en Estados Unidos, Reino Unido, Australia y Canadá para los padres que tengan activadas las herramientas de supervisión parental. Añadió que la función estará disponible en otras regiones hacia finales de este año.

“Estas alertas están diseñadas para brindar a los padres la información necesaria para apoyar a sus hijos adolescentes e incluyen recursos especializados para ayudarlos a abordar estas conversaciones delicadas“, señaló la empresa en un comunicado.

Las notificaciones se activarán cuando un adolescente intente buscar repetidamente términos vinculados con autolesiones, incluyendo frases que sugieran intención de hacerse daño y palabras como “suicidio” o “autolesión”.

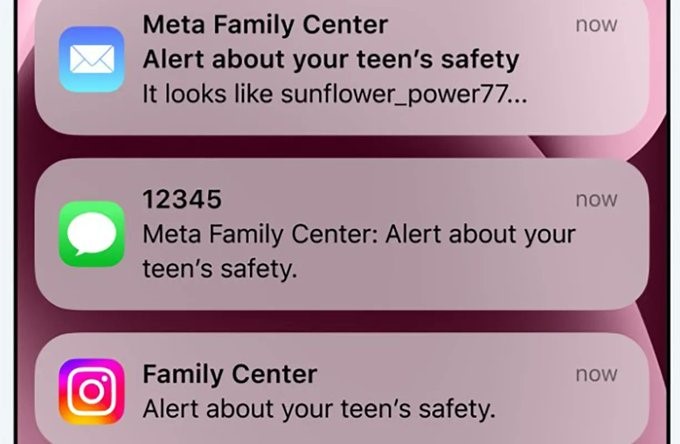

Los avisos serán enviados por correo electrónico, SMS o WhatsApp, según los datos de contacto disponibles, además de mostrarse dentro de la aplicación.

“Al hacer clic en la notificación, se abrirá un mensaje a pantalla completa explicando que su hijo adolescente ha intentado buscar repetidamente en Instagram términos relacionados con el suicidio o la autolesión en un corto período de tiempo. Los padres también tendrán la opción de consultar recursos de expertos diseñados para ayudarles a abordar conversaciones potencialmente delicadas con su hijo adolescente”, detalló Meta.

La tecnológica subrayó que mantiene políticas estrictas contra contenido que promueva o glorifique el suicidio o la autolesión, aunque permite que los usuarios compartan experiencias personales sobre estos temas. No obstante, ese tipo de publicaciones se oculta a menores de edad, incluso si proviene de cuentas que siguen.

La empresa también adelantó que trabaja en alertas similares vinculadas a interacciones con inteligencia artificial, las cuales avisarán a los padres si un adolescente intenta entablar ciertos tipos de conversaciones relacionadas con suicidio o autolesiones con sistemas de IA.

Presión judicial

El anuncio ocurre en un contexto de mayor escrutinio judicial hacia la compañía por presuntos efectos negativos de sus plataformas en la salud mental de menores.

El director ejecutivo de Meta, Mark Zuckerberg, compareció recientemente ante el Tribunal Superior de Los Ángeles por una demanda en la que una usuaria sostiene haber desarrollado adicción a las plataformas durante su adolescencia.

Lee también: ¿Sigues pagando de más? 14% de mexicanos ya cancela sus plataformas de streaming

Durante su testimonio, el empresario reiteró que la verificación de edad de los usuarios debería recaer en los propietarios de sistemas operativos y tiendas de aplicaciones, como Apple y Google, y no en los desarrolladores de aplicaciones.

Con información de EFE